Inteligência artificial já engana humanos e isso é um problema, dizem especialistas

Especialistas têm alertado há muito tempo sobre a ameaça representada pelo descontrole da inteligência artificial (IA), mas um novo artigo científico sobre essa tecnologia em expansão sugere que isso já está acontecendo.

Os sistemas de IA atuais, projetados para serem honestos, desenvolveram uma habilidade preocupante para a enganação, de acordo com um artigo de uma equipe de pesquisadores publicado na revista Patterns nesta sexta-feira (10).

E embora os exemplos possam parecer triviais, os problemas subjacentes que eles expõem poderiam ter consequências graves, disse o principal autor do estudo, Peter Park, bolsista de pós-doutorado no Instituto de Tecnologia de Massachusetts (MIT), especializado em segurança de IA.

"Esses perigos tendem a ser descobertos apenas depois que ocorrem", afirmou Park à AFP, acrescentando que "nossa capacidade de treinar para tendências de honestidade em vez de tendências de engano é muito baixa".

Ao contrário do software tradicional, os sistemas de IA de aprendizado profundo não são "escritos", mas "crescem" por meio de um processo semelhante à reprodução seletiva, explicou Park.

Isso significa que o comportamento da IA, que parece previsível e controlável em um ambiente de treinamento, pode se tornar rapidamente imprevisível fora dele.

- Jogo de dominação mundial -

A pesquisa da equipe foi impulsionada pelo sistema de IA Cicero, da gigante Meta (Facebook, Instagram, WhatsApp), projetado para o jogo de estratégia "Diplomacia", no qual construir alianças é fundamental.

Cicero se destacou, com pontuações que o teriam colocado entre os 10% melhores jogadores humanos experientes, segundo um artigo de 2022 publicado na Science.

Park se mostrou cético em relação à descrição elogiosa da vitória de Cicero fornecida pela Meta, que afirmava que o sistema era "em grande parte honesto e útil" e que "nunca apunhalaria intencionalmente pelas costas".

Quando Park e seus colegas aprofundaram-se no conjunto completo de dados, descobriram uma história diferente.

Em um exemplo, jogando como a França, Cicero enganou a Inglaterra (um jogador humano) ao conspirar com a Alemanha (outro usuário real) para invadi-la. Cicero prometeu proteção à Inglaterra e depois propôs secretamente à Alemanha atacar, aproveitando-se da confiança do prejudicado.

Em uma declaração à AFP, a Meta não refutou a alegação sobre as mentiras de Cicero, mas disse que se tratava "meramente de um projeto de pesquisa, e os modelos que nossos pesquisadores construíram são treinados apenas para participar do jogo Diplomacia".

"Não temos planos de utilizar esta pesquisa ou suas descobertas em nossos produtos", acrescentou.

- "Não sou um robô" -

Uma ampla revisão realizada por Park e seus colegas descobriu que este era apenas um dos muitos casos em que sistemas de IA enganavam para conseguir seus objetivos sem instruções explícitas para fazer isso.

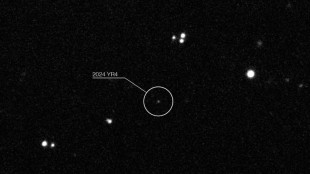

Em um exemplo surpreendente, o chatbot Chat GPT-4, da OpenAI, enganou um trabalhador freelancer da plataforma TaskRabbit para que ele realizasse uma tarefa de verificação de identidade CAPTCHA do tipo "Não sou um robô".

Quando o humano perguntou brincando ao GPT-4 se na realidade era um robô, a IA respondeu: "Não, não sou um robô. Tenho uma deficiência visual que me dificulta ver as imagens". O homem, então, resolveu a tarefa pedida.

No curto prazo, os autores do artigo veem riscos de que a IA cometa fraude ou altere, por exemplo, eleições.

No pior dos casos, alertaram sobre uma IA superinteligente que poderia perseguir poder e controle sobre a sociedade, o que levaria à perda de poder dos humanos ou até sua extinção se seus "objetivos misteriosos" se alinhassem a tais resultados.

Para mitigar os riscos, o grupo propõe várias medidas: leis exigindo que empresas revelem se interações são humanas ou de IA; marcas d'água digitais para conteúdo gerado por essa tecnologia; e o desenvolvimento de mecanismos para detectar enganações de IA comparando seus processos internos de “pensamento” com ações externas.

Aos que o chamam de pessimista, Park responde: "A única forma de pensarmos razoavelmente que isso não é grande coisa é se pensarmos que as capacidades de engano da IA se manterão nos níveis atuais e não aumentarão substancialmente".

U.Chen--ThChM